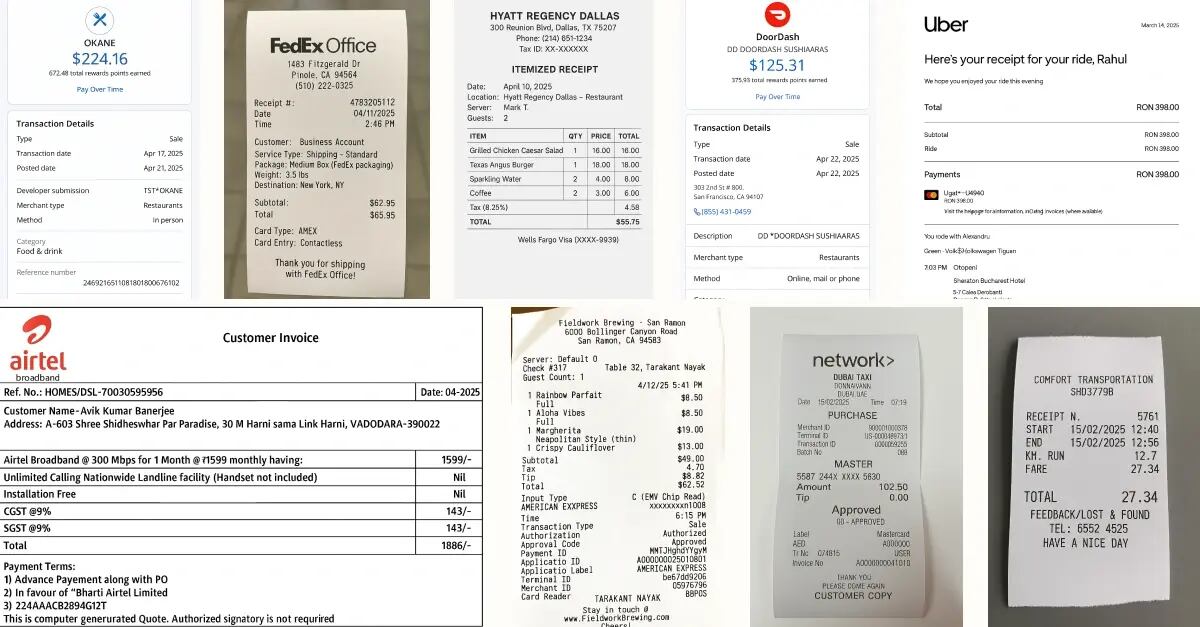

Durante muchos años pasar gastos corporativos para que los cubra la empresa fue una molestia: había que guardar los tickets en papel, anotar los montos, hacer el cálculo final… Luego se simplificó con los tickets digitales, y alcanzaba con enviar una foto de los que eran en papel. Más fácil. Pero con la llegada de la IA generativa surgió un problema: hoy es trivial generar la imagen de un ticket que parece real, y estafar a la empresa para que pague por un gasto que nunca se hizo.

La irrupción de modelos como ChatGPT de OpenAI y Gemini de Google ha generado un dolor de cabeza inesperado para los departamentos de finanzas: el aumento drástico de recibos de gastos falsos, tan convincentes que resultan indistinguibles de los auténticos.

El problema no es una amenaza futura, sino una realidad palpable. Desde el lanzamiento de la IA generativa de imágenes, el fraude en los recibos de gastos se ha incrementado en un 14%, según análisis de AppZen. Las pérdidas son significativas: la pérdida económica promedio por fraude de recibos falsos en EE. UU. alcanza los 133.000 dólares de media, mientras que las pérdidas globales por fraude ocupacional llegaron a US$3100 millones en total. Solo la fintech Ramp detectó más de un millón de dólares en recibos fraudulentos en apenas 90 días con su nuevo software.

Fraude sin barreras de entrada

La falsificación requería antes ciertas habilidades de edición fotográfica; hoy, basta con un smartphone o simples instrucciones de texto a un chatbot para generar un recibo de apariencia perfectamente real en segundos. La herramienta es tan accesible que en una nota del Financial Times el vicepresidente de SAP Concur, Chris Juneau, advierte a sus clientes: “no confíen en sus ojos”.

Estos recibos de última generación no solo clonan logos o manipulan montos y fechas, sino que replican detalles sutiles como arrugas en el papel y hasta firmas.

La carrera armamentística: IA contra IA

Ante esta escalada, las empresas han tenido que recurrir a la misma tecnología para defenderse. Se trata de una constante “carrera armamentística”.

Inicialmente, plataformas como ChatGPT o Gemini incorporaron metadatos a sus imágenes (es decir, elementos digitales en el archivo que avisan que fue generado por una IA) para que las fintechs pudieran identificar el contenido generado por IA. Sin embargo, los empleados han refinado sus técnicas para eludir esta detección: simplemente toman una fotografía o captura de pantalla del recibo generado por la IA y la adjuntan, eliminando así los metadatos de origen.

La respuesta tecnológica a esta elusión es el análisis de patrones. Los sistemas de auditoría automatizada utilizan IA propietaria para ir más allá de la imagen. En lugar de confiar en los metadatos, estos sistemas analizan el contexto del gasto: horarios de viaje, coincidencias de fechas, repetición de nombres o comportamientos inusuales a lo largo del tiempo. Este enfoque es crucial, ya que los humanos tienden a cometer errores o a pasar por alto inconsistencias después de un tiempo.

Detectar estos fraudes es vital no solo por los montos individuales, sino porque cuando un empleado se sale con la suya, se genera una “norma de deshonestidad” dentro de la cultura corporativa. Los expertos recomiendan utilizar la detección de recibos falsos como un sistema de alerta temprana de problemas culturales y asegurarse de que los sistemas de auditoría sean “más inteligentes” que los defraudadores.